抢了人类编辑饭碗的人工智能算法会赢吗?

人工智能夺取了权力,“备胎转正”的戏剧再次在媒体行业上演。

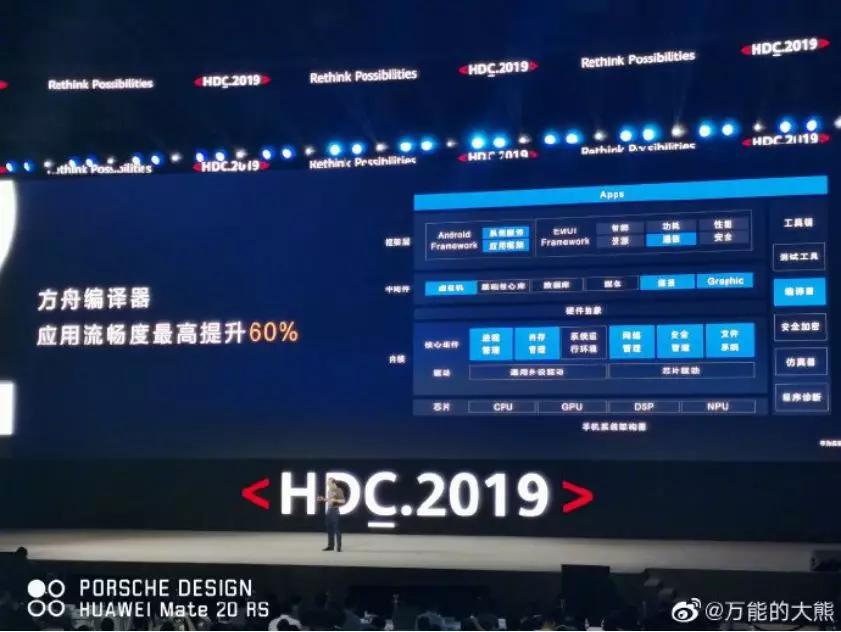

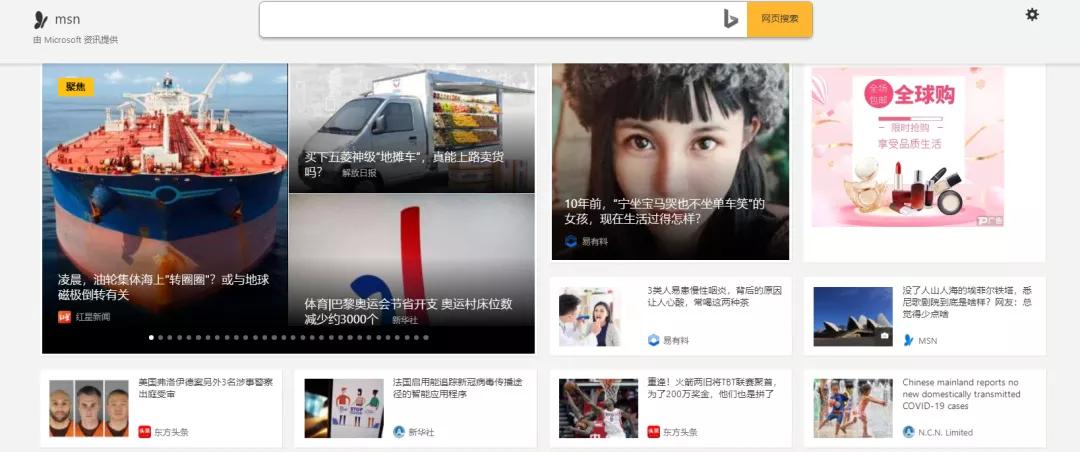

5月底,微软宣布将解雇50名从事新闻报道筛选和策划的编辑,取而代之的是人工智能编辑,他们与这些人工编辑一起工作了一段时间。

受此影响,大约27名负责维护MSN网站和微软边缘浏览器新闻主页的英国报业协会编辑被告知,他们将在6月底被解雇。

尽管微软明确表示,裁员与COVID-19流行病导致的新闻媒体广告收入下降之间没有直接关联,但人工智能技术被用来降低新闻团队的人工成本是一个不争的事实。

对于这些别无选择只能“挨枪子儿”的新闻编辑来说,曾经为他们提供各种新闻和筛选建议的人工智能算法推荐结果是这样一个“秘密锐化”人工智能。

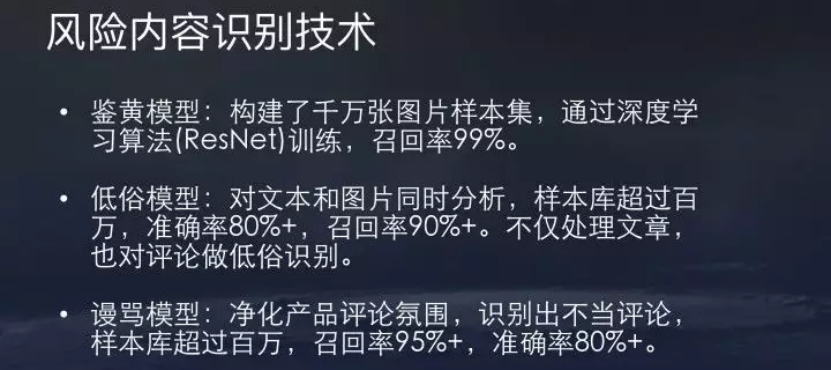

在这份报告中,一位即将被解雇的编辑强调,用人工智能完全取代人工工作是有风险的,因为只有人工编辑才能确保网站不会向用户显示暴力或不适当的内容。这对于人工智能来说确实是个问题,因为它更擅长推荐人类内容,但它不能识别一些潜在的社会伦理风险。

当然,自从微软在1995年推出MSN新闻服务以来,已经有25年了。目前,全球至少有800名编辑仍在从事新闻筛选和推荐工作。未来,微软的新闻团队仍将与人工编辑和人工智能编辑合作,但人工智能取代人工编辑的趋势可能会明显加快。

从吃瓜的普通人的角度来看,我们也被各种新闻信息和视频平台的算法推荐所支配。最明显的经验是,我们花越来越多的时间在让我们“想停下来”的内容上。

人工智能将在取代人类编辑的战斗中赢得最后胜利,这是真的吗?从人工智能算法推荐的优势和争议出发,探讨人工智能算法和人工编辑推荐的可能结果。

信息传播:从“人们寻找信息”到“信息寻找人”

太阳底下没有什么新东西。算法推荐虽然只是近年来随着移动互联网内容应用的爆炸式增长而兴起的,但本质上仍然是一种新的人类信息发布形式,我们对信息发布的需求由来已久。

在《人类简史》,赫拉利提出了一个新的“假说”,即聪明人胜过其他物种,也就是说,我们特别擅长“八卦”和“聊天”。“流言蜚语”帮助整个社区建立情感纽带,团结一致,共同前进和后退。“聊天”有助于传授经验,告诉村民哪里有危险,老猎人教年轻猎人如何捕捉猎物。这是信息最自然的社会分配,极大地提高了人类合作的效率和文明的延续。

从那以后,我们经历了口耳相传的史诗故事、打结的笔记、甲骨文篆刻的符号记录,以及后来的文章和经典;现代文明的繁荣得益于印刷术的不断升级,在过去的二百多年里,新闻报纸、图书出版、广播电视等新的信息传播媒介诞生了,它们构成了当代社会信息传播的基本领域。

互联网的出现突破了信息传播的时间和空间界限,使信息能够在网上和全球传播。然而,传统的互联网信息传输仍然延续着物理世界的范式。例如,互联网早期出现的门户网站和搜索引擎借鉴了图书馆的目录分类和百科全书的条目索引。

新闻和信息的传播依赖于权威和集中组织的收集和报道,用户信息知识的获取依赖于主动浏览和筛选。

随着信息的爆炸式增长和人们信息消费的碎片化趋势,“人们寻找信息”的方式遇到了新的挑战。算法推荐平台的出现和相应的内容分发,开辟了一种以机器算法推荐为手段的“以信息发现人”的新模式。

1995年,尼古拉斯尼葛洛庞帝在《数字化生存》年有了一个“我的每日”的预言,现在它已经成为现实。信息传播正朝着满足受众个人需求的方向发展。

几乎与此同时,明尼苏达大学的团队开发了第一个自动推荐系统GroupLens,并成为协作过滤推荐算法的最早支持者。此后,算法推荐系统很早就在亚马逊的电子商务平台和网飞的视频流服务中投入使用。

2016年可以说是新闻算法推荐的第一年。今年,YouTube将深度神经网络应用于内容推荐系统。今年,在中国新闻信息发布市场上,该算法推动的内容首次超过50%。

也是在这一年,我率先应用了信息算法推荐的今天的标题,并最终突破了四个门户和英美烟草支持的媒体平台,实现了每天6000万次的活动。

然而,算法推荐本身从那以后就一直有争议。2017年9月,人民日报特别批评了今天头条的“算法推荐”。自然,社论首先肯定了算法推荐符合时代潮流,满足了人们个性化和多样化的信息获取需求,但具体指出了以下问题:

算法推荐会纵容劣质内容的扩散。一些推荐算法只迎合了公众的好奇心,最终反复推出低质量的内容。最后,“劣币驱逐良币”,这使得传统媒体的高质量和全面的信息无法到达公众用户。

推荐算法中所谓的“个性化”推荐只会机械地推荐一些相关性强但内容单一的信息,甚至过滤掉那些不熟悉和不愉快的信息,形成一个“信息茧”。

该算法推荐的信息捕获可能不仅涉及大量的版权问题,甚至可能走向“创新的反面”。也就是说,智能推荐将走向媚俗化,充斥着肤浅的内容,缺乏独立思考和深入观察,这反过来又会破坏社会的创新和发展。

《人民日报在线》的批评也代表了许多传统媒体和精英的观点,这些现象确实符合我们大多数人的直觉印象。但在呼应之前,我们还需要进一步了解算法推荐的基本方法和发展,并找出为什么人们如此容易被算法驯服。算法推荐如何突破其局限性并继续发展?

算法推荐:人类,太人类了

信息传播的本质是将人与信息有效地联系起来。算法推荐的实质是利用机器算法实现大规模的自动信息发布,使信息能够自动发现人。

因此,算法推荐需要解决三个问题:了解信息、了解人、知道人们何时何地需要这些信息。然而,归根结底,算法推荐的核心是理解人,即理解人的使用习惯和爱好,然后通过加权推荐算法预测用户可能感兴趣的信息和话题。

新闻信息的主要推荐算法来源于一些数学算法。以下算法主要用于主要的新闻信息聚合应用:

1.内容推荐。这是最常用的信息推荐算法。算法系统对文本内容进行标记,一旦用户点击、浏览、喜欢、评论和分享相关内容,系统将对用户进行相应兴趣的标记。这样,更多相关的标签文本可以与用户标签相匹配。例如,阅读过德甲内容的用户将获得更多关于德甲的信息。

在内容推荐中,如果不能提前获得用户的兴趣标签特征,很容易遇到冷启动问题。因此,除了内容推荐之外,还需要其他推荐方法。

2.协同过滤推荐。这是推荐系统中使用的最早和最成功的技术之一。它采用“物以类聚,物以类聚”的思想,即找到用户的朋友或其他具有相似特征的用户,并推荐给用户

协同过滤推荐采用体验共享的方式,避免了内容分析不准确和内容推荐过于单一的问题,能够为用户发现潜在的兴趣偏好内容。

3.热门推荐。流行推荐来源于传统媒体的思维模式,主要基于当前热点新闻事件和话题。不同于传统媒体的人工筛选,新闻聚合平台的自动算法推荐是通过数据统计的方式,将一段时间内点击量和关注度最高的新闻推给用户。

此外,还有一系列基于规则、效用、知识和各种组合的推荐算法来实现对用户的个性化推荐。

也就是说,对于那些使用算法推荐的内容平台,他们有一个“秘密武器”来对付处于信息焦虑和饥饿中的移动互联网用户。即使你是一个新手用户,并且平台对你知之甚少,它也会让你定制兴趣标签,尝试不同类型的内容推送、AB测试等等,并找到你真正的爱好,从而快速实现所谓的“冷启动”。

然而,从根本上说,像今天的头条这样的内容平台有一个基本的“原罪”,那就是,平台的目的是尽可能多地抓住用户的时间和注意力,而不是让用户获得基本信息然后转身离开。

新闻广播有一个准时的结束,但是这些内容平台可以在任何时候被更新并且无限期地提供,并且获得流量是其操作的本质。因此,该平台的推荐算法将尽可能取悦用户,并利用用户的人性弱点来反馈信息。

这正是内容平台经常被人们批评的问题:标题党猖獗,洗稿文章猖獗,深谙人性弱点的色情低俗内容层出不穷。一旦出于好奇浏览相关内容,该算法将完全推荐更多相关信息。这也是所谓“信息茧室”的根本原因。该算法纵容人性,这反过来巩固了认知,导致用户在熟悉的信息圈中打转。这也是许多人讨厌内容平台的深层原因,但他们似乎无法停止。

但是,应该指出的是,算法推荐本身并不一定要为内容平台的这些问题承担责任,原因很简单,就是“人用刀杀人,但责任在人,而不是刀”。事实上,通过算法推荐本身的进化,这种用户的信息“偏食”行为和“信息茧室”问题可以得到解决。

算法推荐自助:人机合作是正确的方式

无论对算法推荐的批评有多严重,算法推荐的流行是一个不争的事实。算法推荐的真正进步在于改变了信息发布的方式,即从“负责任的编辑和检查”的集中发布模式转变为基于用户个性化机器智能推荐的“算法检查”的发布模式。

这种分发方式极大地提高了信息分发的效率,当然也带来了传统权威专业媒体分发算法的失败和分发内容权重的下降。然而,目前,传统权威媒体不再有最初的消极和压抑态度,而是以积极的态度拥抱新媒体平台,参与算法推荐的流量竞争,并凭借其官方身份和专业内容在新媒体时代重新获得用户认可。

对于算法推荐导致的“劣币驱逐良币”的问题,以前的确是算法推荐的一个弱点。一些最早的机器学习算法和推荐算法无法识别文章内容是否涉嫌标题派对、虚假新闻、洗稿、低俗、色情等等。这些劣质内容实际上是平台一直试图消除的隐患。

毕竟,平台的发展不能仅仅依靠这些内容,还会带来很多版权、投诉和负面的舆论。如今,该平台增加了内容安全机制的建设,包括高风险内容识别模型技术的广泛应用和大规模的人工审查和验证。去年,由于虚假新闻的泛滥,就连同样痴迷于算法推荐的脸书也开始使用人工编辑来审查内容。

至于“信息茧屋”,正如北京师范大学教授于国铭最近在《算法推荐必然导致“信息茧房”效应吗》的一篇论文中指出的,算法推荐并不是“信息茧屋”形成的必要条件。“信息茧屋”形成后,算法推荐并没有起到协同作用,甚至起到了一定的消化作用。

简单地说,“信息茧屋”的存在并不是由于算法推荐的出现。传统社会的单一信息、严格的媒体控制和个人信息的“偏食”倾向都是造成“信息茧屋”的原因。相反,在算法推荐时代,个人用户也有来自传统媒体渠道和社交媒体渠道的多种信息源,这种“信息窝棚”的生成机制就更加难以创建;同时,随着迭代算法推荐技术的发展,用户潜在的信息需求不断被挖掘和丰富。

最后,在算法推荐和人工编辑推荐之间的权衡中,我们实际上应该推荐一个具有“人文理性”和“技术理性”的可信算法推荐系统。显然,该算法仍然更容易为用户提供“沉浸式”信息阅读体验,算法与人之间的互动本质上是“算法背后的设计者价值逻辑或意识形态与用户之间的互动”。这就要求算法设计者在认识到“信息茧屋”可能带来的危害后,积极寻求更优化的解决方案,建立可信的算法推荐系统。

除了算法推荐,最重要的是坚持人机协作,即在算法推荐的基础上,注重手工编辑的应用,包括提供新闻专业性的概念和设置更多的公共议题;提供更多加权的正面和负面观点信息;提供更多关于随机视角等的信息。

回到微软新闻部门裁员的时候,以前的模式是人工智能算法来辅助人类新闻编辑,但是将来人类新闻编辑更有可能会辅助人工智能算法来优化内容推荐的质量。显然,人工智能算法推荐不能完全取代人工编辑。该平台不信任人工智能算法会给出其信誉和内容的所有选择。

一项技术的发明和应用在人类发展的历史上一直只是起着催化剂或催化剂的作用。

就人工智能算法推荐而言,它不会破坏传统媒体的生存基础,也不会完全把人类变成短视的傻瓜。

事实上,如果我们仔细观察,当你发现你周围的老人开始整天盯着他们的手机,关注发生在他们自己城市的各种事情,关注政府发布的各种政策和媒体上各种精彩的狗血故事,这不是他们生活和精神的解放,至少它拓宽了他们的视野,他们再也不用盯着家里的琐事了。

对于那些因为人工智能而发迹的媒体人来说,没有必要悲观地叹息。夜深人静时,你会开始无休止地写作,这些内容平台可能会给你一个更光明的未来。