注意机制想要唤醒人工智能 总步骤?

疫情导致所有离线会议都按下暂停按钮,人工智能也不例外。

然而,一年一度的“高层会议”必须举行,所以在4月26日,ICLR 2020(国际代表和学习会议)采取了虚拟会议的形式,允许所有的网民参加盛大的仪式。

值得一提的是,ICLR会议接受了2 594篇论文中的687篇,吸引了来自近90个国家的5 600多名与会者,比2019年的2 700多倍。然而,由于疫情,会议没有选择最好的论文。

在这种情况下,有什么新的东西值得思考和探索吗?

接下来,我们不得不提到“人工智能觉醒”,这是图灵奖获得者、蒙特利尔学习算法研究所所长尤舒亚本吉奥在他的特别报告中强调的。

在此之前,我们已经知道了一般人工智能有多远。人工智能如何在短短几年内苏醒?这必须从本吉奥认为是机器学习杀手的注意力机制开始。

将意识注入机器:注意力机制加重了负担

大脑极性体的高级读者应该熟悉注意机制。在过去的两年中,注意力模型已经被引入到机器学习任务中,例如图像处理、语音识别和自然语言处理。

如此受业界欢迎,它的特点自然脱颖而出:

一是神经网络可以学习只关注特定的部分,大大提高了任务的效果和效率,并在神经机器翻译、预训练语言模型、图像识别等任务中显示出前所未有的效果。在Bahdanau等人于2015年提出注意机制后,他们被ICLR雇佣。现在它的变体已经成为机器翻译算法的“标准”。

第二是降低机器学习的成本,同时增加可解释性。众所周知,深度学习神经网络的模型训练通常依赖于大规模数据集。不仅数据采集的成本很高,而且计算能力和训练时间也很昂贵。注意机制的“选择性”可以直接提高训练的质量和效率,还可以为序列数据建立权重和映射,从而允许输入和输出相联系,避免算法的“黑箱”。

既然注意机制不是一个新事物,为什么本吉奥在他的报告《与意识相关的深度学习先验》中故意把注意机制作为标准,甚至成为人工智能的希望?

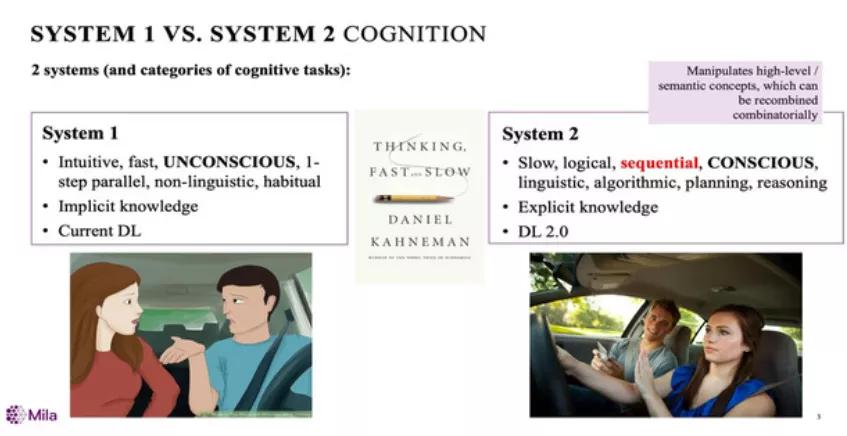

简而言之,本吉奥认为注意机制可以帮助机器学习模型获得“有意识”的推理。

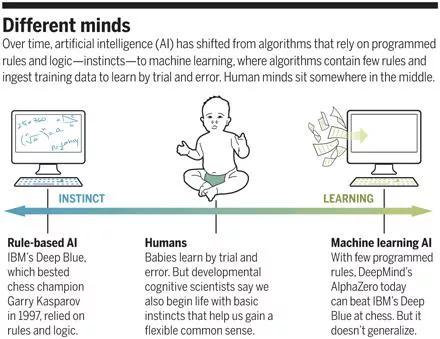

以前,许多算法创新(如自我监督学习、元学习、多任务学习、迁移学习等)。)都在帮助机器学习获得“无意识”,即类似于人类直觉、习惯、先前经验等的能力。

有了这种能力,人工智能可以快速执行一些直观的任务,让人感觉非常聪明。例如,人工智能在接受培训并学习了一些隐性知识后,可以将知识内化并快速适应新事物,而无需再培训。例如,当人工智能记住路况时,它可以自由地与乘客聊天,而不会延迟它对交通状况的反应并安全驾驶。这是否超过了许多人类驾驶员?

然而,如果司机在一条崭新的道路上行驶,如果有人在他耳边吵闹,他会打断司机的思维,使对方无法集中精力处理。在这个时候,前面提到的“有意识”系统将被用来在新的环境下把一些新概念和不熟悉的事物联系起来。

正如神经科学家、《西部世界》的科学顾问大卫伊格尔曼所说,意识是一种突破程序设置的联系。

当机器能够超越设定,开始独立思考,适应甚至推断外部变化的原因时,这难道不是德洛丽丝(《西部世界》女主角)醒来的时刻吗?

从这个角度来看,“有意识的”推理能力正是深入学习所需要变得更强的。

从超越人到模仿人——人工智能的回归

既然“操纵”的意识如此敏感,学者们是如何为它工作的呢?近几年来,注意机制经历了长足的发展和进步。

从时间的角度来看,自2014年谷歌团队在RNN卷积神经网络模型上使用注意能力机制对图像进行分类以来,该机制就一直被人工智能所使用。然而,真正的爆发主要是由于它在自然语言处理机器翻译任务中证明了自己。

2017年,谷歌的机器翻译团队发表了《Attention is all you need》,提出了一种新颖的基于注意力的机器翻译架构,并广泛使用自我注意机制来学习文本表示,成为本年度最有影响力的论文之一。

后来,它开始广泛用于基于神经网络模型的自然语言处理任务,如CNN美国有线电视新闻网,并扩展了许多变体。例如,基于输入项目的项目式软注意、基于输入项目的项目式硬注意、基于位置的位置式软注意等。核心指导思想是相似的,即在神经网络的隐含层增加注意机制的权重。

然而,应该注意的是,在注意机制中仍然存在许多问题:

例如,注意机制与其说是一种技术,不如说是一种指导思想。通过模拟人类在阅读、听力和口语中的注意力行为,不同的权重被分配给不同的输入数据。想要达到理想的效果,还需要大量的数据投入训练。

可以说,注意力机制在神经机器翻译(NMT)任务中的突出表现仍然是以大量高质量语料库为前提的。一旦面临更极端的情况,比如一些语言几乎没有双语语料库,即使是最强的注意机制也会被蒙蔽。

另一个例子是,注意机制实现“有意识”推理的前提是具备理解隐性知识的能力,即难以用文字、词语和图表表达和解释的能力,是通过感官、直觉和理解而不是逻辑推理获得的。

这对于人类来说是一块“蛋糕”,但是把它嵌入到深度学习算法中并不是一件简单的事情。DeepMind开发了一个互动网络,试图教代理人快速理解某些对象(如婴儿)的属性和关系。交互式网络的预测结果比一般神经网络的预测结果要精确得多,但模拟人类直觉的快速反馈还为时过早。此外,机器必须犯上千个错误才能像人类一样正常工作。

换句话说,本吉奥的“注意力机制”实际上是“注意力3.0”的升级版,离“机器觉醒”还有很长的路要走。

机器醒了。仅仅关注是不够的。

上述问题不仅阻碍了注意力机制的“通往上帝之路”,也阻碍了人工智能发挥更高的价值。

下一步该何去何从,也许就像注意力机制被引入RNN一样,继续在其他领域积极引入算法和模型会带来不可预知的神奇效果。

然而,从ICLR 2020的技术趋势来看,许多算法已经被用于解决机器能力的重要问题,例如直觉和概括以及注意机制。

例如,元学习。在今年的精选论文中,谷歌有5篇文章致力于元学习。

简而言之,元学习是让代理从过去的知识和经验中“学习学习”,然后更有效地完成新的任务。

有了这种能力,它自然能够解决训练数据不足和系统通用性低的问题,帮助人工智能不断丰富和修正自己的知识网络。有了这种能力,已经获得人类常识的人工智能,只能希望达到“有意识”的推理。

最后,打开一个脑洞也是必要的。想象一下,如果“有意识的”推理得以实现,人工智能真正觉醒,它将给人类带来什么?

猜想1:人工智能的服务能力将明显提高。在实践中学习和处理复杂的工作将不再困难。想象中的智能家用机器人和智能女友/男友不再是问题。

猜想2:人工智能可以像人类一样推理,同时也有情感,所以它自然可以推断出自己的社会关系。我们也不知道当时为什么整个社会需要像我这样的普通人。

幸运的是,无论是注意力机制还是今天的人工智能本身,都需要更长的时间和更大的耐心来重现人类的脑力。更令人欣慰的是,人工智能仍然引领着全球实业家在流行的“黑天鹅”的席卷下连接、思考和探索未来的宝藏地图,这也许是技术最迷人的一面。